Nvidia dévoile les dernières puces, une technologie pour accélérer le calcul de l’IA

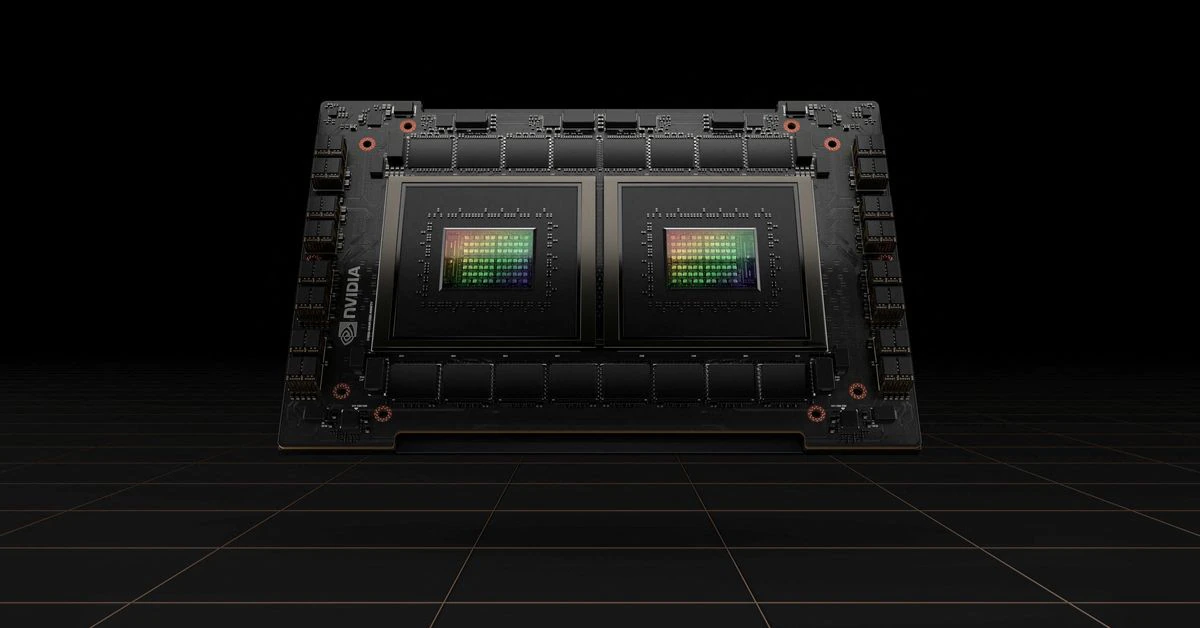

La nouvelle puce CPU Grace de Nvidia dévoilée lors de la conférence des développeurs d’IA du fabricant de puces est visible dans cette image non datée obtenue par Reuters. Nvidia/Document via REUTERS

Inscrivez-vous maintenant pour un accès GRATUIT et illimité à Reuters.com

22 mars (Reuters) – Nvidia Corp (NVDA.O) a annoncé mardi plusieurs nouvelles puces et technologies qui, selon elle, augmenteront la vitesse de calcul d’algorithmes d’intelligence artificielle de plus en plus compliqués, intensifiant la concurrence contre les fabricants de puces rivaux en lice pour les activités lucratives des centres de données.

Les puces graphiques (GPU) de Nvidia, qui ont initialement contribué à propulser et à améliorer la qualité des vidéos sur le marché des jeux, sont devenues les puces dominantes que les entreprises utilisent pour les charges de travail d’IA. Le dernier GPU, appelé H100, peut aider à réduire les temps de calcul de quelques semaines à quelques jours pour certains travaux impliquant la formation de modèles d’IA, a déclaré la société.

Les annonces ont été faites lors de la conférence en ligne des développeurs d’IA de Nvidia.

Inscrivez-vous maintenant pour un accès GRATUIT et illimité à Reuters.com

« Les centres de données deviennent des usines d’IA – traitant et affinant des montagnes de données pour produire de l’intelligence », a déclaré le PDG de Nvidia, Jensen Huang, dans un communiqué, qualifiant la puce H100 de « moteur » de l’infrastructure d’IA.

Les entreprises utilisent l’IA et l’apprentissage automatique pour tout, de la recommandation de la prochaine vidéo à regarder à la découverte de nouveaux médicaments, et la technologie devient de plus en plus un outil important pour les entreprises.

La puce H100 sera produite sur le processus de pointe de quatre nanomètres de Taiwan Manufacturing Semiconductor Company (2330.TW) avec 80 milliards de transistors et sera disponible au troisième trimestre, a déclaré Nvidia.

Le H100 sera également utilisé pour construire le nouveau supercalculateur « Eos » de Nvidia, qui, selon Nvidia, sera le système d’IA le plus rapide au monde lorsqu’il sera opérationnel plus tard cette année.

La société mère de Facebook Meta (FB.O) a annoncé en janvier qu’elle construirait cette année le supercalculateur d’IA le plus rapide au monde et qu’il fonctionnerait à près de 5 exaflops. Nvidia a déclaré mardi que son supercalculateur fonctionnerait à plus de 18 exaflops.

Les performances d’Exaflop sont la capacité d’effectuer 1 quintillion – ou 1 000 000 000 000 000 000 – de calculs par seconde.

Nvidia a également introduit une nouvelle puce de processeur (CPU) appelée Grace CPU Superchip, basée sur la technologie Arm. C’est la première nouvelle puce de Nvidia qui utilise l’architecture Arm à être annoncée depuis que l’accord de la société pour acheter Arm Ltd s’est effondré le mois dernier en raison d’obstacles réglementaires.

Le Grace CPU Superchip, qui sera disponible au cours du premier semestre de l’année prochaine, connecte deux puces CPU et se concentrera sur l’IA et d’autres tâches nécessitant une puissance de calcul intensive.

De plus en plus d’entreprises connectent des puces à l’aide d’une technologie qui permet un flux de données plus rapide entre elles. Plus tôt ce mois-ci Apple Inc

Nvidia a déclaré que les deux puces CPU étaient connectées à l’aide de sa technologie NVLink-C2C, qui a également été dévoilée mardi.

Nvidia, qui a développé sa technologie de conduite autonome et développé cette activité, a déclaré avoir commencé à expédier son ordinateur de véhicule autonome « Drive Orin » ce mois-ci et que le constructeur chinois de véhicules électriques BYD Co Ltd (002594.SZ) et le constructeur de voitures électriques de luxe Lucid Motors (LCID.O) utiliserait Nvidia Drive pour ses flottes de nouvelle génération.

Danny Shapiro, vice-président de Nvidia pour l’automobile, a déclaré qu’il y avait 11 milliards de dollars d’activités automobiles dans le « pipeline » au cours des six prochaines années, contre 8 milliards de dollars qu’il prévoyait l’année dernière. La croissance des revenus prévus proviendra du matériel et de l’augmentation des revenus récurrents des logiciels Nvidia, a déclaré Shapiro.

Les actions de Nvidia étaient relativement stables dans le commerce de midi.

Inscrivez-vous maintenant pour un accès GRATUIT et illimité à Reuters.com

Reportage de Jane Lanhee Lee, reportage supplémentaire de Joseph White; Montage par Bernard Orr

Nos normes : Les principes de confiance de Thomson Reuters.